在计算机视觉领域深度学习在音频处理中的应用,DeepSeek有助于图像识别任务,比如对照片中深度学习在音频处理中的应用的物体进行分类和检测,应用于安防监控中深度学习在音频处理中的应用的目标识别自动驾驶中的场景感知等还可用于图像生成,比如生成逼真的风景人物图像等在音频处理方面,DeepSeek能实现语音识别,将语音准确转换为文字,为语音助手会议记录等场景提供支持也能用于。

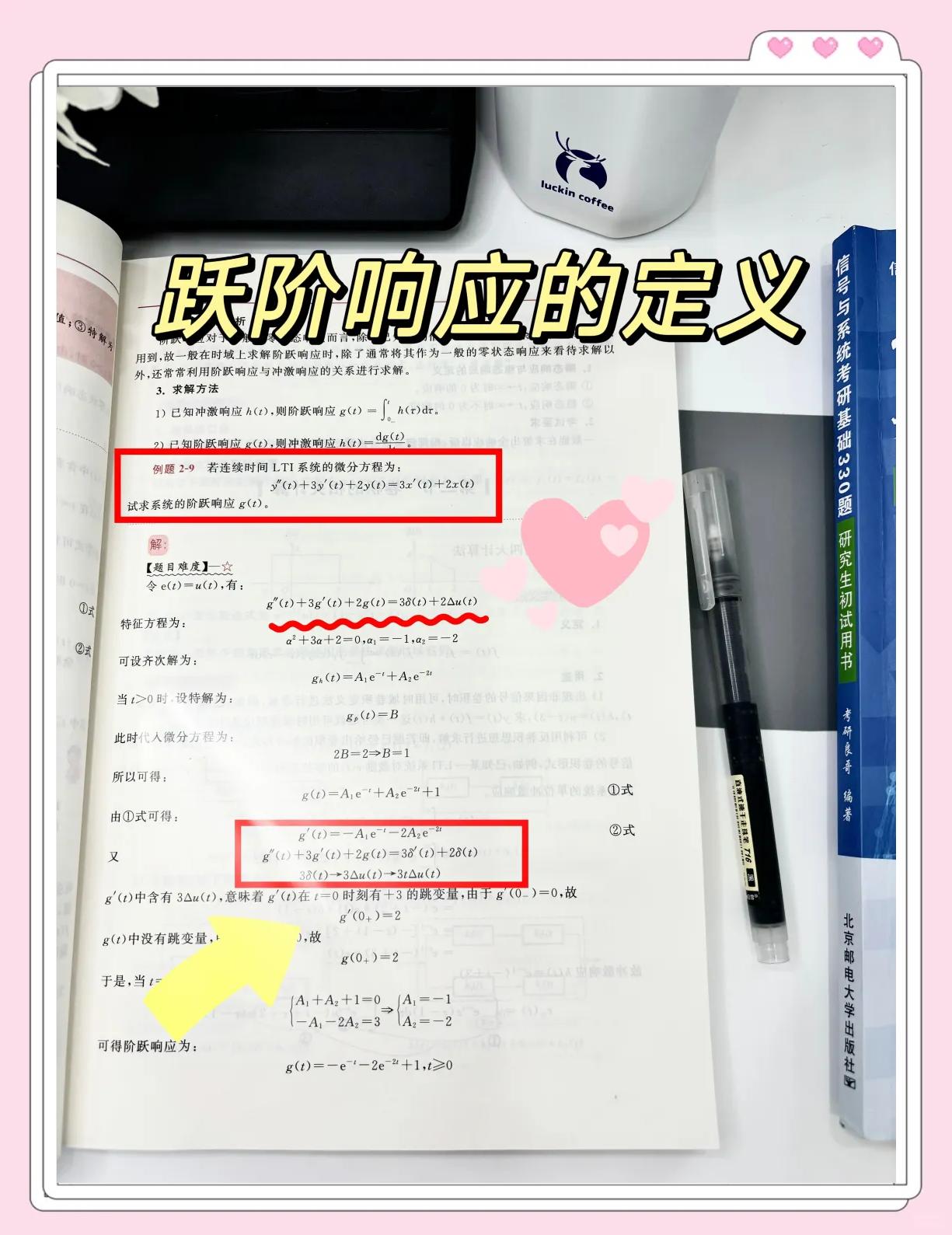

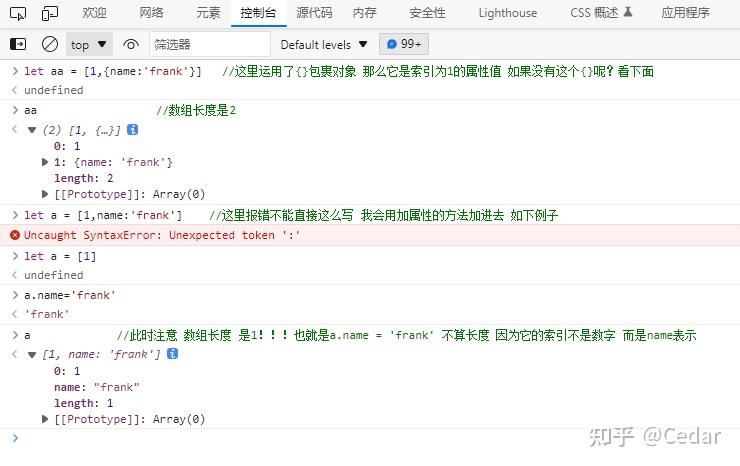

在音频领域,Mel频谱和MFCC是核心特征数据,广泛应用于深度学习模型,解决分类分离等业务问题,如端点侦测节奏识别和弦识别音高追踪乐器分类音源分离回声消除等仅仅使用这些特征和网络结构,可能无法充分解决某些业务问题理解这些特征的内在逻辑细节和扩展,对于结合深度学习解决业务问题至关重。

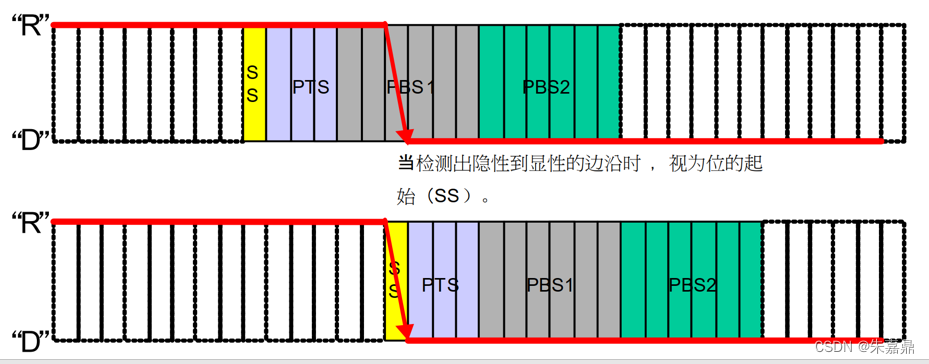

在深入理解深度学习系统后,我们采用短时傅里叶变换STFT将音频信号转换到频域,使用Hamming窗进行处理网络输入由8个连续的噪声STFT向量组成,每个输出都基于当前噪声和先前的噪声向量进行预测为了生成目标和预测器Predicter,首先定义系统参数接着,将音频转换为8 kHz,并从噪声向量中提取随机段。

在音频处理领域Dain是一个音频处理框架,它通过深度学习技术自动增强输入音频数据的质量利用dain,可以提高音频的清晰度进行降噪处理,甚至合成人声,是音频领域中非常重要的一个工具在视频处理领域Dain技术主要用于视频处理,可以通过简单的半自动处理方式将24fps的视频转换为60fps,同时还能够对画面。

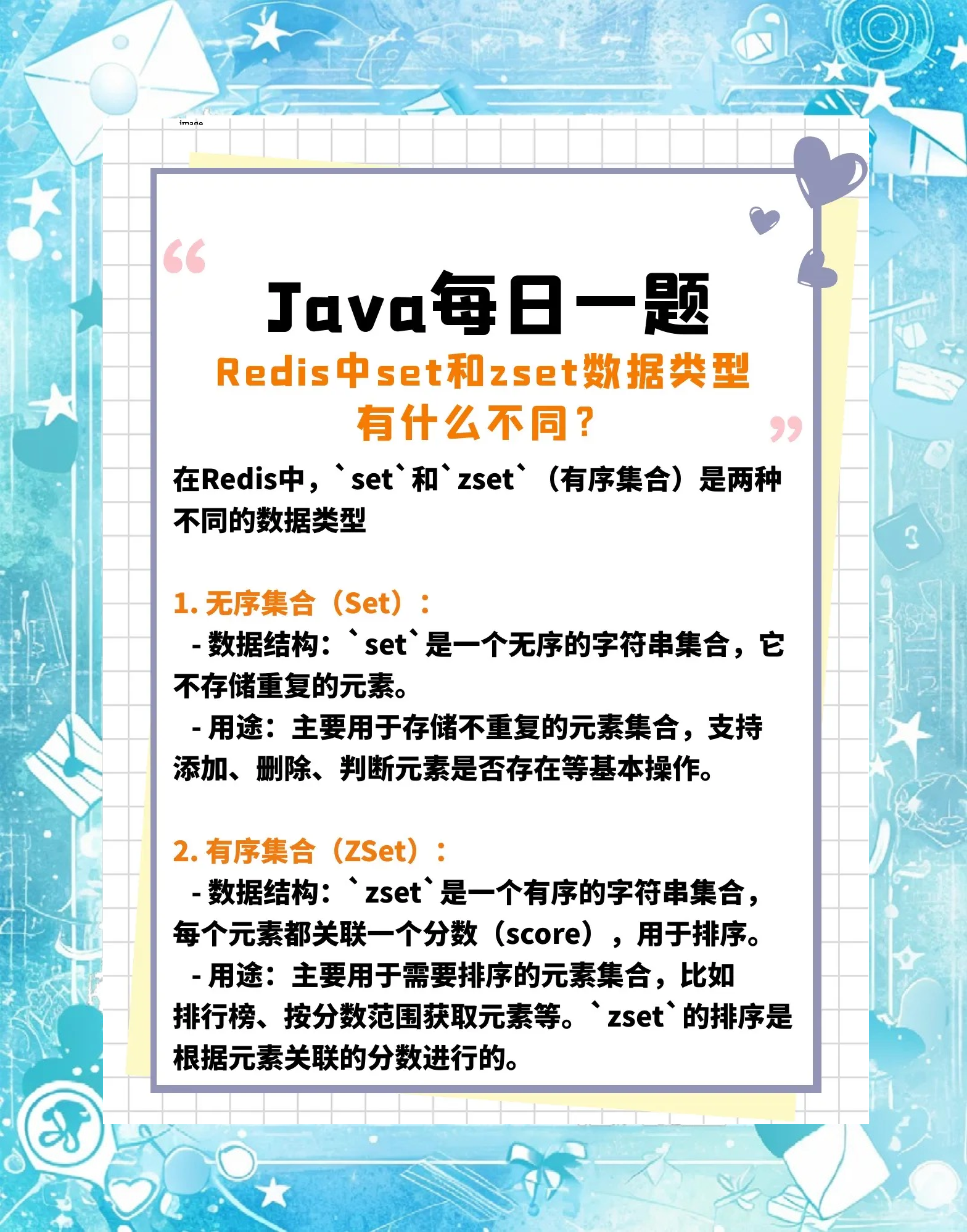

Beam Search方法作为ASR模型推理过程中的改进搜索策略,能够获得更优解此技术通过在每个时间步选择多个可能性较高的字符,从而提高解码结果的准确性总结而言,ASR技术通过深度学习方法处理语音数据,将音频转换为文本,并通过各种算法和架构解决对齐重复字符等挑战,实现高效准确的语音识别。

2 接下来,使用SpeechBrain开源的预训练模型进行特征抽取这些模型能够提供有效的音频特征表示,便于后续处理具体操作包括组合成批次进行处理,使用pad将片段调整至相同长度,此过程在speechbrain库的readme中已有详细说明3 经过特征抽取后,获得的输出被整理为特定格式,通常为batch,1,192的特征片段。

这些工具广泛应用于语音识别音乐制作和电影音效,提升音频体验未来,音频降噪技术将更加智能和自动化,人工智能和机器学习将推动技术进步,硬件设备也将提升处理效率总的来说,通过掌握并应用这些音频处理工具,我们可以轻松地提升音频的清晰度,享受更纯净高质量的听觉享受。

3, 在近些年的影视游戏音乐等行业中,Ai音效技术的应用越来越广泛相对于以往的音频制作方式,Ai音效可以更快速更准确地生成所需的音频效果,并且还可以通过深度学习生成更高质量的音频效果AI音效是自动化音质电视可以自动识别播放的电影节目,综艺节目,新闻节目,儿童节目,体育节目,自动化调成。

6 应用领域这项技术可以广泛应用于音频制作音乐制作视频后期制作等领域,为用户提供灵活高效的音频处理工具7 实时调整用户可能能够根据需要实时调整分离参数,以达到最佳分离效果,满足不同场景和个人偏好综上所述,轻秒音分轨AI是一项结合了深度学习和实时处理技术的音频处理工具,它使得用户。

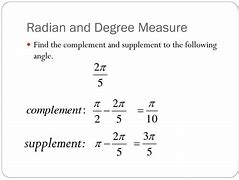

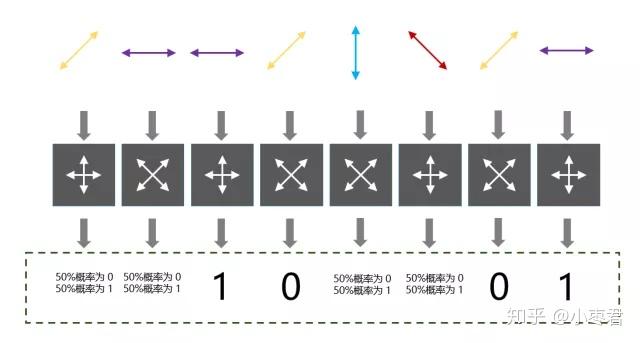

在音频处理中,Mel频谱和MFCC技术是核心特征,它们广泛应用于深度学习模型中,以解决诸如端点检测节奏识别等任务然而,单纯依赖这些特征并不能解决所有业务问题,理解它们的内在逻辑细节和扩展性至关重要接下来,我们逐步剖析这两种技术的算法流程1 **预加重**通过高通滤波器补偿高频,提高信号。

关于音频的AI降噪处理,存在多种开源的库和实用的降噪器首先,我们来看看开源音频编解码器Speex,它在压缩和还原音频数据方面表现出色,尤其在提高网络音频传输和语音通信的清晰度方面这款工具兼容常见的音频格式,如WAVMP3另一款值得关注的是深度学习框架TensorFlow它广泛应用于多种领域,包括语音。

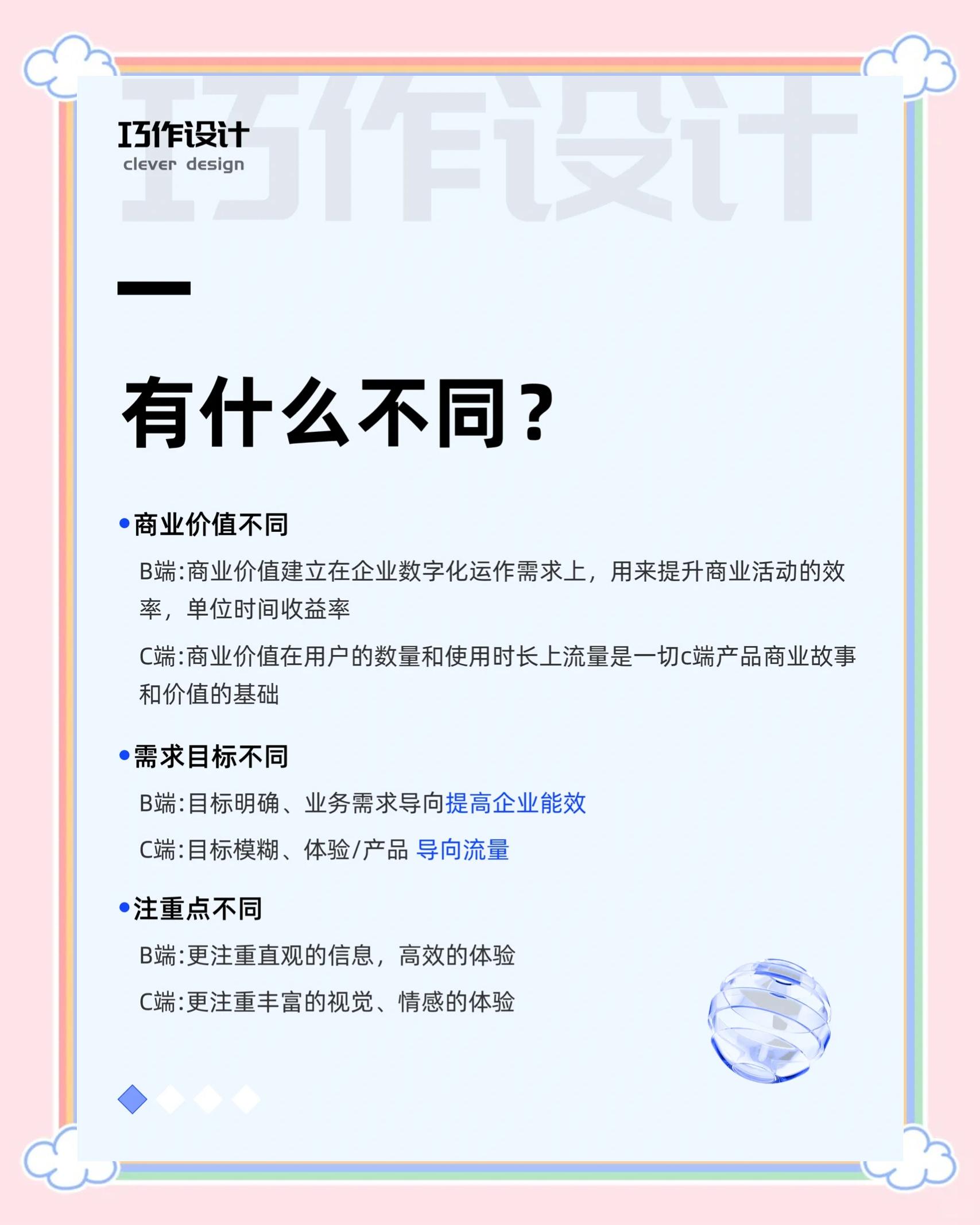

AI人工智能和AE音频工程是两个不同的领域,它们分别代表了技术和艺术的两个方面AI人工智能AI是指由计算机系统执行的模拟人类智能行为的技术它包括机器学习深度学习自然语言处理计算机视觉等多个子领域AI的目标是使计算机能够像人一样思考学习和解决问题在实际应用中,AI可以。

怎样一键分离歌曲的人声和伴奏推荐使用轻秒音分轨,傻瓜式操作,在线分离人声,极速分离背景音乐和人声人声分离是一种音频处理技术,旨在从混合音频中分离出特定的人声部分这对于语音识别语音增强音频编辑等应用非常有用AI在人声分离中的应用通常涉及深度学习和神经网络技术以下是人声分离的一般。

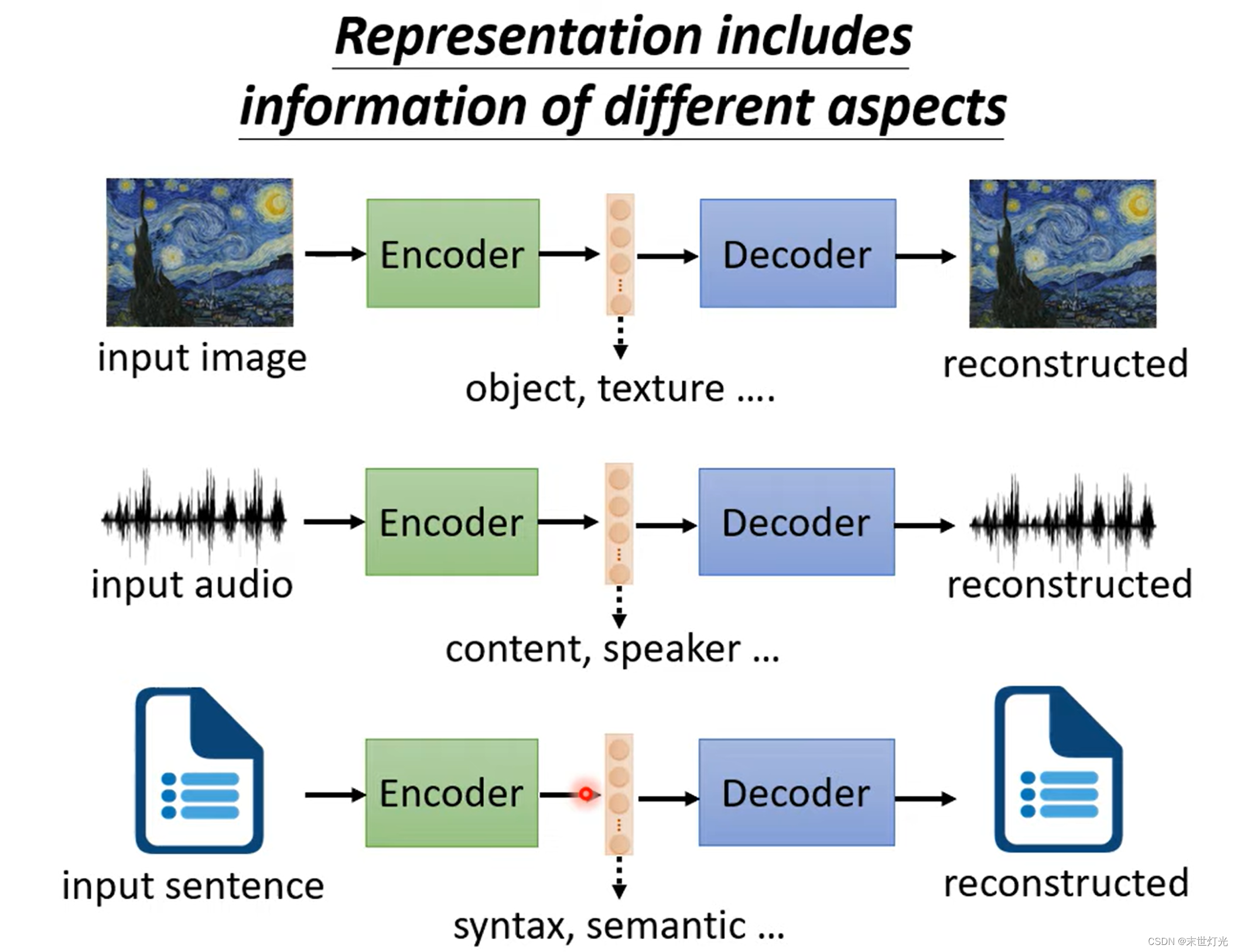

深度学习中的注意力机制革新性解读与广泛应用 在深度学习的殿堂中,注意力机制犹如一盏明灯,照亮了处理长序列信息的困境它不仅提升了RNNLSTMGRU架构的EncoderDecoder模型性能,还广泛应用于机器翻译语音识别图像标注和文本处理等领域它的核心在于赋予模型区分能力,通过对输入词语赋予不同权重。

深度学习模型 使用卷积神经网络CNN等深度学习结构,模型能够通过学习输入音频的特征来分离人声循环神经网络RNN可以处理音频的时序性特征提取 模型通过卷积层等结构提取音频数据中的频谱和时域特征,有助于区分人声和其他声音训练 在标签数据上训练模型,调整模型参数以最小化预测与实际标签。

AI模拟声线是通过深度学习和机器学习技术来实现的,在具体的实现过程中,可能包括以下步骤1 数据采集收集大量的人类歌唱声线的录音数据这些数据将用于训练AI模型2 数据预处理对采集到的声线数据进行预处理,包括去噪降噪音频分段等这些预处理步骤有助于减少噪音和优化声音的表现3。

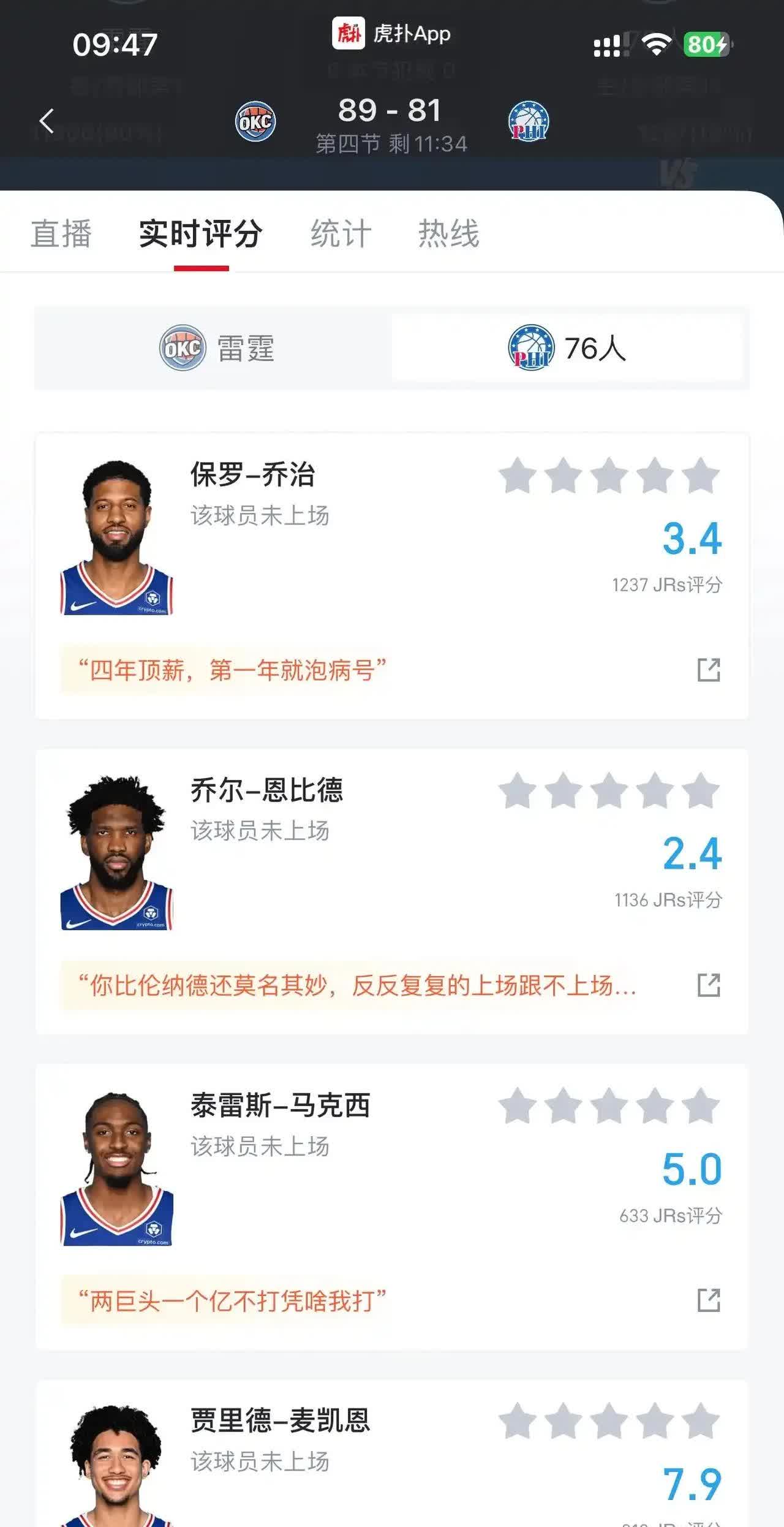

网友评论

最新评论